L’intelligence artificielle générative bouleverse de nombreux domaines, dont la profession juridique. Depuis l’arrivée de ChatGPT en 2022, cette technologie s’impose dans les cabinets, aidant à rédiger des documents, analyser des informations et accompagner les avocats dans leurs recherches.

Mais cette avancée s’accompagne de défis majeurs. Les questions de confidentialité, d’exactitude des résultats et d’équité deviennent centrales. Dans le secteur du droit, où la rigueur prédomine, aucune erreur n’est permise. Les institutions mettent donc en œuvre des cadres précis pour accompagner l’intégration de ces nouveaux outils.

Cet article détaille l’impact de l’IA générative sur le monde juridique. Il met en lumière ses défis, les nouvelles règles qui apparaissent, ainsi que les perspectives offertes par ces technologies.

1. Un métier en pleine transformation

En France et en Europe, l’IA générative change profondément la façon de travailler des juristes. Des solutions comme ChatGPT permettent de gagner du temps pour la rédaction de contrats, la recherche d’informations et l’élaboration d’arguments. Cependant, chaque avocat reste responsable des productions générées. Il doit contrôler la qualité et la fiabilité des documents.

Le cadre européen impose déjà des règles strictes aux systèmes d’IA jugés « à haut risque », notamment en matière de transparence et de sécurité. Les écoles de droit adaptent leur formation et intègrent des modules sur l’IA pour préparer les étudiants à ces nouveaux enjeux.

2. Confidentialité et protection des données

L’IA générative soulève de nombreuses inquiétudes quant à la protection des informations sensibles. Ces technologies utilisent d’énormes volumes de données, ce qui peut exposer des éléments confidentiels. Les cabinets doivent garantir que les données sont traitées de manière conforme et sécurisée. Ils doivent héberger les informations en Europe et appliquer des mesures de pseudonymisation, y compris lors de transferts hors de l’Espace Économique Européen.

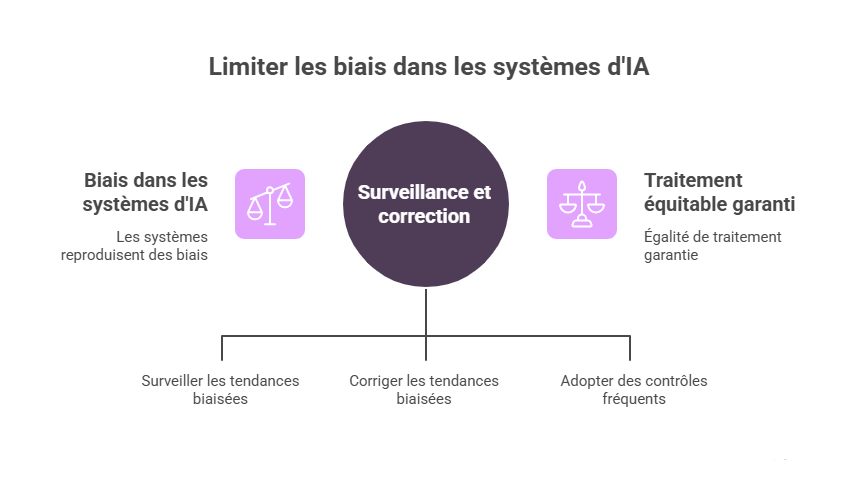

3. Biais et équité : limiter les risques

Même les systèmes les plus avancés reproduisent parfois des biais liés à leurs jeux de données. Les concepteurs doivent surveiller et corriger régulièrement ces tendances. Les cabinets juridiques adoptent des contrôles fréquents pour limiter les biais et garantir une égalité de traitement.

4. Responsabilité et supervision

L’usage de l’IA dans le droit obéit à des règles très strictes. De plus en plus de structures nomment des référents IA chargés de superviser ces outils, de former les juristes, et d’éviter les dérives. Chaque professionnel du droit informe ses clients si une IA intervient dans leur dossier et précise les limites de l’outil.

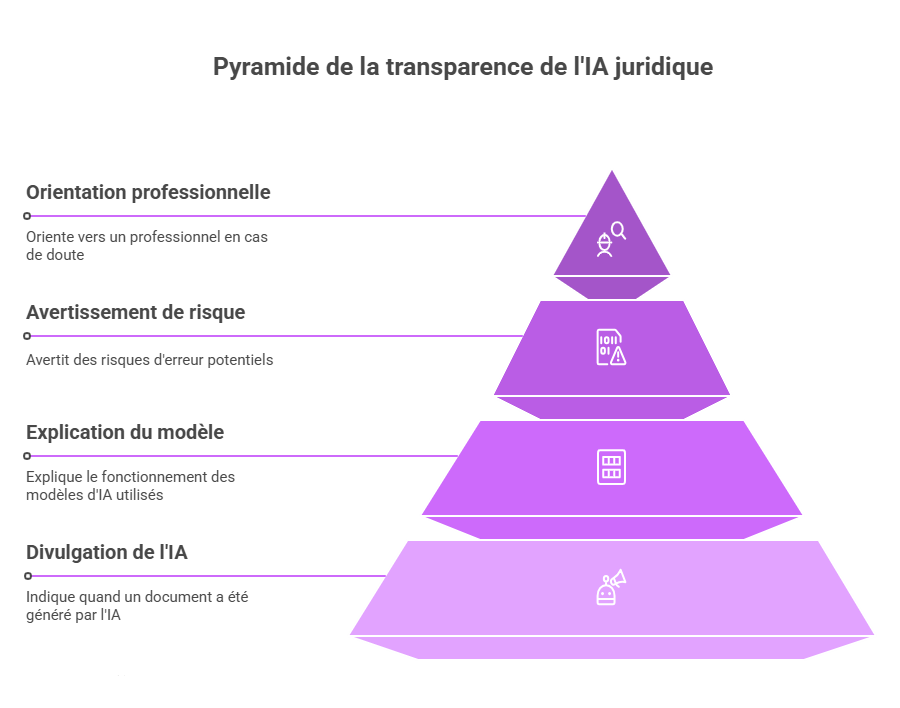

5. Importance de la transparence

Informer le client reste fondamental. Les legaltechs précisent désormais quand un document a été généré grâce à l’IA et expliquent le fonctionnement des modèles utilisés. Elles préviennent également des risques d’erreur et orientent vers un professionnel en cas de doute.

6. Tarification et facturation : éthique et clarté

L’automatisation ne doit pas permettre des pratiques tarifaires abusives. Les avocats ne facturent désormais que le temps passé à vérifier et valider les résultats produits. Ils communiquent clairement à leurs clients la nature des tâches réalisées et le temps consacré à chaque étape.

7. Justice et régulation

Les tribunaux adaptent progressivement leur organisation à ces outils innovants. Ils mettent en avant la transparence et la désignation de référents pour accompagner les usages de l’IA et prévenir les abus. Les réglementations récentes ont retenu l’intégration responsable des technologies tout en protégeant les droits des justiciables

Les juridictions françaises et européennes commencent à s’adapter aux bouleversements induits par l’IA générative. Les nouvelles réglementations renforcent les exigences de transparence et incitent à la nomination de référents spécialisés dans l’IA pour garantir son utilisation éthique et maîtrisée au sein des tribunaux.

Conclusion : une pratique en transition vers l’innovation responsable

L’intelligence artificielle générative ouvre de vastes perspectives pour le secteur juridique mais impose de nouveaux défis, qu’ils soient éthiques, techniques ou organisationnels. Grâce aux récentes évolutions réglementaires et à l’engagement des professionnels, un équilibre se dessine entre innovation technologique et protection des droits fondamentaux. Seule une approche responsable, associée formation continue et vigilance déontologique, permettra d’intégrer durablement l’IA au service d’une justice plus efficace et équitable.